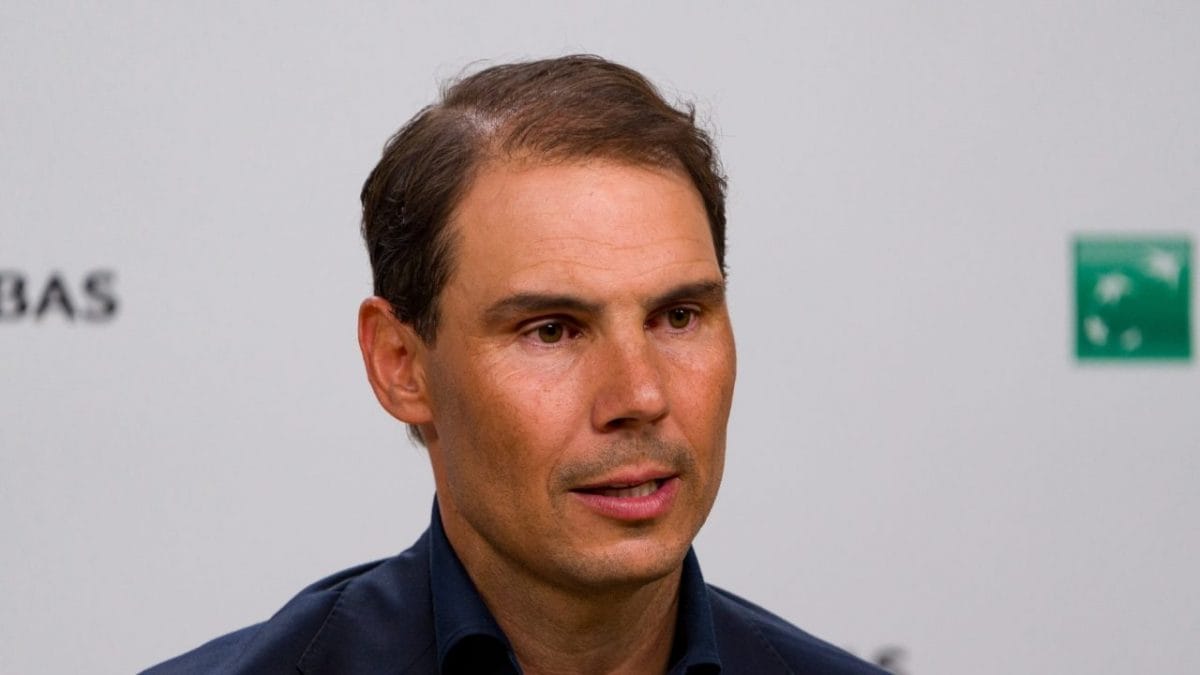

Rafa Nadal costretto a fare un post: “Sono video falsi, è qualcuno che mi somiglia e parla come me”

Rafa Nadal è stato costretto a pubblicare un post sul proprio profilo ufficiale su X per smentire che quel suo sosia – uguale in tutto e per tutto a lui, nel volto e nella voce – che promuove degli investimenti, chiaramente truffaldini, sia effettivamente il 39enne campionissimo di tennis ritiratosi lo scorso anno. Nadal è solo uno dei tanti personaggi famosi che sono stati ‘clonati', in maniera ormai quasi indistinguibile dal vero, per fare da testimonial farlocchi per delle frodi. L'implementazione massiccia dell'intelligenza artificiale ha fatto da volano al proliferare di queste situazioni.

Il messaggio di Rafa Nadal su X: "Circolano video falsi creati con l'intelligenza artificiale"

"Condivido questo avviso, cosa insolita per me sui social media, ma credo che sia necessario – ha scritto Nadal nel suo post – Il mio team e io abbiamo individuato dei video falsi che circolano su alcune piattaforme, creati con l'intelligenza artificiale, in cui qualcuno sembra assomigliare e parlare come me. Questi video promuovono consigli o offerte di investimento che non provengono da me. Fanno parte di un sistema pubblicitario ingannevole. Si prega di fare attenzione: non ho creato né approvato alcun contenuto di questo tipo. Grazie per il vostro supporto!".

In questi video ingannevoli si vede il finto Nadal che raccomanda piattaforme di trading o investimenti in crypto/finanza, con la sua voce ricreata artificialmente che dice cose tipo "ho guadagnato milioni con questa app, provala anche tu".

I filmati sono parte di schemi fraudolenti, dove si cerca di spingere le persone a versare soldi. La ‘copia' del vip che promuove l'imbroglio è così simile all'originale, che purtroppo non sono in pochi quelli che ci cascano, soprattutto persone che non hanno conoscenza di come sta evolvendo il mondo del ‘deepfake' e di quanto l'IA possa ormai riprodurre sosia fedelissimi, nel fisico e nella voce, degli originali.