I carabinieri usano un software addestrato sui civili palestinesi a Gaza: il caso Corsight

Lo scorso giugno, fingendo di essere un rappresentante di un’azienda di cybersecuity privata, il giornalista di Fanpage.it Luigi Scarano ha partecipato sotto copertura a Praga, in Repubblica Ceca, all’Iss World Europe, la conferenza internazionale dove le principali aziende produttrici di strumenti di sorveglianza e spionaggio incontrano i rappresentanti dei governi e dei servizi segreti di tutto il mondo. Tra i principali espositori e relatori della convention figuravano aziende come Nso Group, nota per aver prodotto lo spyware zero click Pegasus, ma anche le italiane Area, Sio, Movia, Rcs e Ips, che riforniscono le procure italiane dei principali strumenti di intercettazione.

Ve lo abbiamo raccontato nella nostra inchiesta sulla rete per spiare cittadini, giornalisti e attivisti.

È in questo evento qui che il giornalista sotto copertura di Fanpage.it riesce ad avere un incontro con un emissario dell’azienda israeliana Corsight per una dimostrazione del suo software: “Questa è la nostra soluzione per il riconoscimento facciale, è utilizzata principalmente da servizi segreti.”, ci dice mostrandoci come funziona il programma. Corsight, fondata nel 2019 come spin-off della società israeliana Cortica, oggi opera globalmente in oltre 50 paesi, ha una sede originaria in Israele, ma anche uffici negli Stati Uniti e nel Regno Unito.

L’azienda sviluppa tecnologie avanzate per l’identificazione di volti in tempo reale, impiegate in settori come la sicurezza pubblica, i trasporti, ma anche in altri contesti. I suoi prodotti principali promettono prestazioni elevate anche in condizioni difficili: “Sai com’è la situazione in Israele con i militanti di Hamas a Gaza tra la popolazione civile? È la sfida più grande per il riconoscimento facciale a livello globale – ci spiega il responsabile dell’azienda Israeliana – Questo strumento è usato anche dallo Shin Bet, l’agenzia per la sicurezza interna, ed è uno strumento tattico: vedi – ci dice mentre ci mostra un video promozionale – la telecamera è all’esterno sotto il sole a 40 gradi, col fango, le persone non stanno guardando verso la telecamera, stanno solo camminando, ma noi siamo in grado di identificare i militanti di Hamas dalla popolazione civile anche se camminano con l’hijab. I nostri clienti sono solo quelli che contano, non possono perdere il prossimo Bin Laden, potrebbe comparire una volta ogni tanto, forse una volta sola in dieci anni: non puoi fartelo sfuggire.”

Corsight però non serve con i suoi prodotti solo l’intelligence israeliana, ma annovera tra i clienti numerose forze di polizia, enti governativi e aziende private, potendo vantare la sua fama di azienda leader nel riconoscimento facciale. Tra queste forze dell’ordine e queste aziende private, infatti, ci racconta il rappresentante dell’azienda, in Italia ci sarebbero anche i Carabinieri e l’aeroporto di Roma Fiumicino: “Questo è lo strumento usato dalle più grandi lussuose e sensibili organizzazioni del mondo: anche i Carabinieri sono una di queste, poi ci sono l’FBI, la NATO. Lavoriamo con molte organizzazioni private civili, con molti aeroporti: anche con Fiumicino per esempio, che usa il nostro riconoscimento facciale”.

Le implicazioni etiche dell'uso di Corsight

L’uso di Corsight, soprattutto in ambito militare e di sicurezza nazionale, ha già dato adito in passato a diverse controversie. Una delle vicende più discusse ha riguardato l’uso della sua tecnologia proprio in un vasto programma di riconoscimento facciale nella Striscia di Gaza per identificare membri di Hamas. Dopo l’attacco di Hamas del 7 ottobre 2023 e l’inizio dell’offensiva di terra israeliana, l’esercito israeliano (in collaborazione con l’unità d’intelligence Unit 8200) ha avviato un progetto sperimentale di sorveglianza biometrica, compilando un database massivo di volti di cittadini palestinesi senza la loro consapevolezza né consenso. In questo programma, fotografie raccolte da droni, riprese di sicurezza e perfino immagini da social media venivano confrontate con il database tramite il software Corsight, allo scopo di “selezionare” individui ritenuti affiliati a gruppi militanti.

Le criticità emerse sono state notevoli. Innanzitutto, secondo fonti militari stesse, la tecnologia di Corsight ha mostrato inconsistenze nell’analizzare filmati, con casi di falsi positivi preoccupanti. L’episodio più noto riguarda il poeta palestinese premio Pulitzer Mosab Abu Toha, che nel novembre 2023 stava attraversando un checkpoint a Gaza con la famiglia quando le telecamere dotate del riconoscimento facciale di Corsight lo hanno segnalato come volto presente nella lista dei ricercati dalle autorità israeliane. Abu Toha è stato quindi fermato, bendato, detenuto e interrogato per due giorni – per poi essere rilasciato senza accuse quando è stato accertato che si trattava di un errore di identificazione. In seguito a questo episodio, l’intero progetto è stato messo in discussione perché attuava una forma di sorveglianza di massa su una popolazione civile già vulnerabile: decine di migliaia di volti di comuni cittadini palestinesi sarebbero stati raccolti e schedate in database militari, violando principi basilari di privacy e diritti umani, secondo osservatori indipendenti.

Corsight però sarebbe utilizzato anche in un altro contesto controverso: l’identificazione dei manifestanti nelle proteste negli atenei statunitensi. A confermarlo al giornalista sotto copertura di Fanpage.it è sempre l’emissario dell’azienda israeliana: “Negli Stati Uniti è una cosa seria, specie nelle università esiste un gruppo, che è privato, non è governativo, e il loro compito è quello di fare in modo che queste persone la paghino. Sono enormi, parlo di un database con centiaia di milioni di persone: vuol dire che se partecipi alle manifestazioni finisci nel database. Se sei il promotore o leader dell’evento pubblicano il tuo profilo online. E qualche volta le persone vengono licenziate. È il più grande sistema di riconoscimento facciale del mondo in assoluto”.

Negli Usa, infatti, come raccontato dal rappresentante di Corsight, diversi gruppi privati come Betar Usa e Canary Mission pubblicano sui loro portali lunghi elenchi di studenti e professori identificati e segnalati come attivisti pro-Palestina, per consentire ai funzionari federali di perseguirli legalmente. Il caso più significativo è quello di Mahmoud Khalil, cittadino algerino con residenza permanente negli USA, che è stato arrestato da agenti dell'ICE senza mandato, nel suo alloggio universitario a New York, dopo che il suo profilo e la sua foto erano stati diffusi da queste organizzazioni. Quello di Khalil è stato il primo caso pubblico di un residente permanente detenuto e perseguito per il suo attivismo pro-Palestina sotto l’amministrazione Trump.

Perché Corsight non può essere usato

Al di là del profilo etico, in Italia si pone una questione legale relativa all’utilizzo di Corsight. Nel nostro Paese, infatti, l’articolo 9, comma 9, del Decreto-Legge 139/2021, convertito con modificazioni dalla Legge n. 205/2021, prevede la sospensione dell’installazione e l’utilizzo di impianti di videosorveglianza con sistemi di riconoscimento facciale da parte di autorità pubbliche o soggetti privati in luoghi pubblici o aperti al pubblico. Questa sospensione è stata motivata dalla necessità di attendere una disciplina legislativa dei requisiti di ammissibilità, delle condizioni e delle garanzie per l’impiego dei predetti sistemi conforme ai principi del GDPR e della Carta dei diritti fondamentali dell’Unione europea, ed è valida fino al 31 dicembre 2025.

Infatti c’è una sostanziale differenza tra la videosorveglianza tradizionale e i sistemi biometrici in tempo reale. La prima si limita a registrare ciò che accade: le immagini sono archiviate e, in caso di necessità, visionate da operatori umani. I sistemi biometrici invece non si limitano a osservare, ma elaborano attivamente i volti e altri tratti fisici o comportamentali per identificare in modo univoco una persona all’interno di un flusso video in diretta. È proprio questa automazione a rendere tali strumenti pericolosi per la libertà individuale: l’intelligenza artificiale decide in tempo reale chi sei e se rappresenti una minaccia.

L’utilizzo dei sistemi di identificazione biometrica è oggi regolamentato a livello europeo. Il 21 maggio 2024 è stato approvato l’AI Act, la prima legge dell’Unione europea sull’intelligenza artificiale. Il regolamento ha introdotto un divieto generale sull’impiego dei cosiddetti sistemi di identificazione biometrica remota “in tempo reale” all’interno di spazi accessibili al pubblico ai fini di attività di contrasto. Il motivo di questo divieto è semplice: si tratta di tecnologie altamente invasive, che possono compromettere la riservatezza e la libertà delle persone. Tuttavia, l’AI Act prevede eccezioni ben circoscritte e unicamente quando necessario: ad esempio per cercare vittime di alcuni reati gravi o persone scomparse; prevenire una minaccia specifica e imminente alla vita o all’incolumità fisica delle persone o una minaccia reale di un attacco terroristico; oppure identificare e localizzare soggetti sospettati di reati gravi, punibili con una pena o una misura di sicurezza privativa della libertà della durata massima di almeno quattro anni.

Anche in questi casi, però, l’impiego di sistemi biometrici, dovrebbe essere autorizzato preventivamente da un’autorità giudiziaria o da un’autorità amministrativa indipendente. In presenza di situazioni di emergenza, come un attentato in corso o la fuga di un sospetto armato, sarebbe possibile procedere anche senza autorizzazione, a patto che l’urgenza sia debitamente giustificata e l’autorizzazione venga richiesta senza indebito ritardo, al più tardi entro 24 ore. Se l’autorizzazione non viene concessa, l’uso del sistema deve essere interrotto immediatamente e tutti i dati raccolti devono essere cancellati.

Il caso Essex

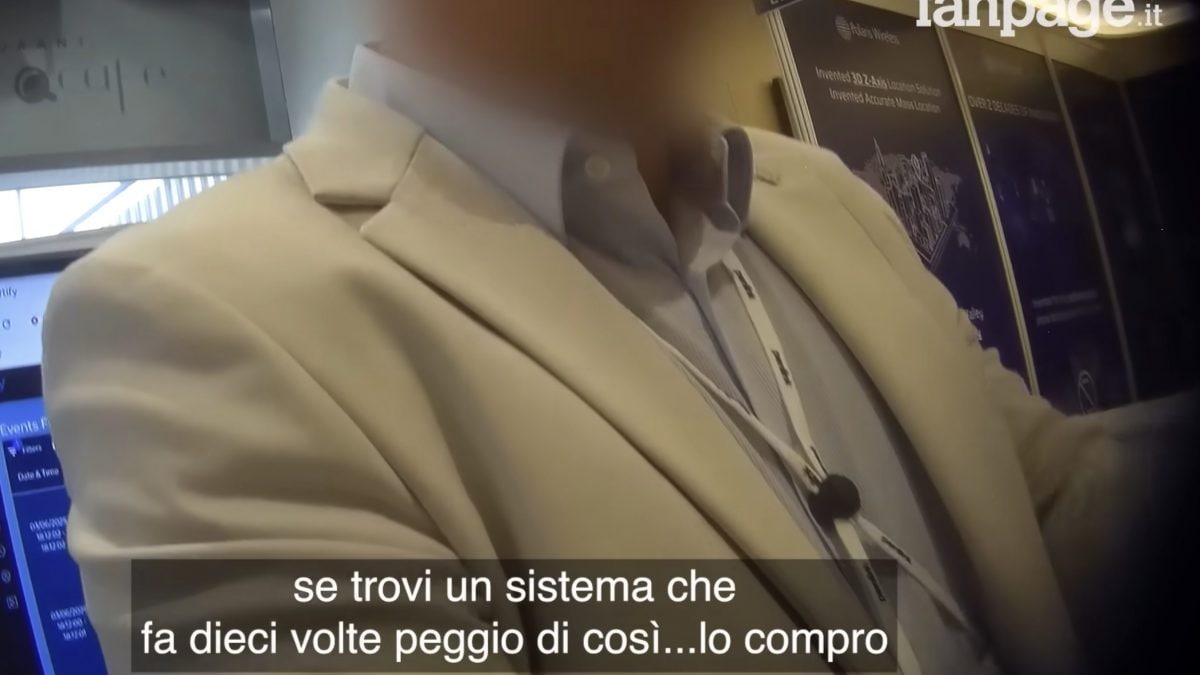

Corsight invece può essere usato per il riconoscimento facciale automatico in Regno Unito, dove la forza di polizia più grande ad averlo implementato è quella dell’Essex: “Questi sono i dati ufficiali pubblicati online dalla polizia dell’Essex una delle principali forze dell’ordine. Loro dicono: in due giorni abbiamo monitorato 1,8 milioni di volti, abbiamo ottenuto 203 alert di riconoscimento facciale, abbiamo 68 arresti, e abbiamo un solo falso allarme: lo 0,000…% di errore. Se trovi un sistema che fa dieci volte peggio di così, lo compro.”, afferma compiaciuto il rappresentante dell’azienda al giornalista sotto copertura di Fanpage.it.

L’implementazione di Corsight nell’Essex però, solleva più di un dubbio anche oltremanica, dove l’associazione non governativa Aoav (Action on Armed Violence), che conduce ricerche e sostegno sull'incidenza e sull'impatto della violenza armata globale, ha cercato di ottenere trasparenza presentando una richiesta ufficiale (FOI) per sapere se ci fossero stati contatti diretti tra la polizia britannica e l’azienda. La risposta delle autorità è stata evasiva: si sono rifiutate di confermare o smentire qualsiasi incontro, alimentando così sospetti e preoccupazioni sull’opacità dei rapporti tra forze dell’ordine e aziende private coinvolte in pratiche di sorveglianza potenzialmente discriminatorie.

A complicare ulteriormente le cose c’è l’Equality Impact Assessment (EIA) redatto dalla polizia per valutare i rischi del riconoscimento facciale. Secondo alcuni esperti, il documento è pieno di incoerenze: si basa su test effettuati su un software diverso da Corsight, e cita dati sulle performance che non risultano da fonti indipendenti. In altre parole, l’assessment che dovrebbe garantire l’assenza di discriminazioni razziali del software israeliano si baserebbe su presupposti errati o fuorvianti.

Corsight può essere venduto a chiunque

Il rappresentante dell’azienda israeliana conclude la sua dimostrazione offrendo al giornalista sotto copertura, che si era presentato come l’emissario di un’azienda privata, la possibilità di acquistare il suo prodotto: “Le compagnie private non sono proibite voglio sapere che stando a queste condizioni, dal punto legale, siamo a posto che non ci sarà nessuna causa, che nessuno si lamenterà che non perderò la mia reputazione e che non perderò tempo e soldi sono sicuro che c’è una soluzione sono sicuro che troveremo un accordo e sono sicuro che c’è un modo di farlo.“