Le foto che state vedendo della guerra in Iran non sono tutte vere: abbiamo cercato da dove vengono

“Tutto o parte del contenuto di questa immagine è stato generato o modificato con l'intelligenza artificiale di Google”. L’immagine in questione mostra un bombardamento in Iran. L’ho vista online, l’ho caricata su Gemini e sottoposta all'analisi di SynthID. Non c’è un watermark, un simbolo o una scritta. All’apparenza sembra un’immagine reale, solo qualche dettaglio tradisce la natura artificiale, confermata poi dall’analisi inversa.

Non è l’unica immagine artificiale sul conflitto in Iran. Online ci sono decine di foto di bombardamenti, colonne di fumo, città in fiamme, aeroporti distrutti create con IA. Alcune pubblicate anche da testate nazionali. Abbiamo trascorso ore a cercare di distinguere le immagini false da quelle reali. I risultati della nostra analisi mostrano una rete diffusa di account fake e immagini IA che stanno restituendo una narrazione distorta del conflitto in Iran.

Cosa abbiamo trovato online: foto e video fake

La lista delle immagini e dei video creati con IA è lunga. C’è la foto di un aeroporto iracheno esploso, un bombardamento all’ambasciata statunitense a Riyad, filmati di caccia Usa abbattuti, e riprese che mostrano un incendio in una raffineria di petrolio in Arabia Saudita.

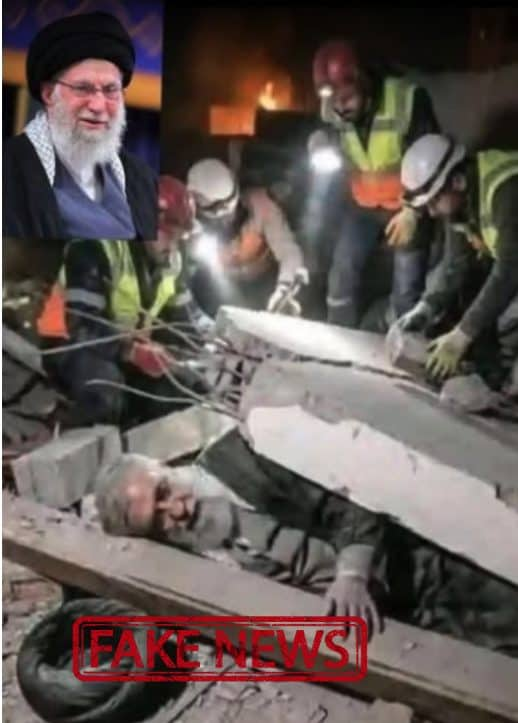

Un’altra fotografia diventata virale raffigura la Guida Suprema iraniana, Ali Khamenei, senza vita sotto le macerie. Anche in questo caso si tratta di un falso generato con l’intelligenza artificiale. I media di Stato iraniani hanno riferito che Khamenei è stato ucciso durante bombardamenti su Teheran, ma finora non sono state diffuse immagini verificate del recupero del corpo.

Ci sono anche immagini reali ma decontestualizzate. Per esempio, un video presentato come il funerale di Khamenei, con “milioni di persone” in corteo. In realtà mostra le esequie del leader di Hezbollah Hassan Nasrallah, tenutesi a Beirut nel febbraio 2025. Le bandiere libanesi e quelle del movimento sciita, visibili sulle bare e lungo il corteo, rendono evidente l’errore di attribuzione.

Anche le immagini satellitari della distruzione di un grande radar militare statunitense nella base di Al Udeid, in Qatar, sono dei falsi. La prima foto non ritrae la base qatariota, ma la sede della Quinta Flotta della Marina USA in Bahrain. La seconda appare invece come una versione manipolata digitalmente della stessa fotografia.

L'origine delle immagini create con l'IA

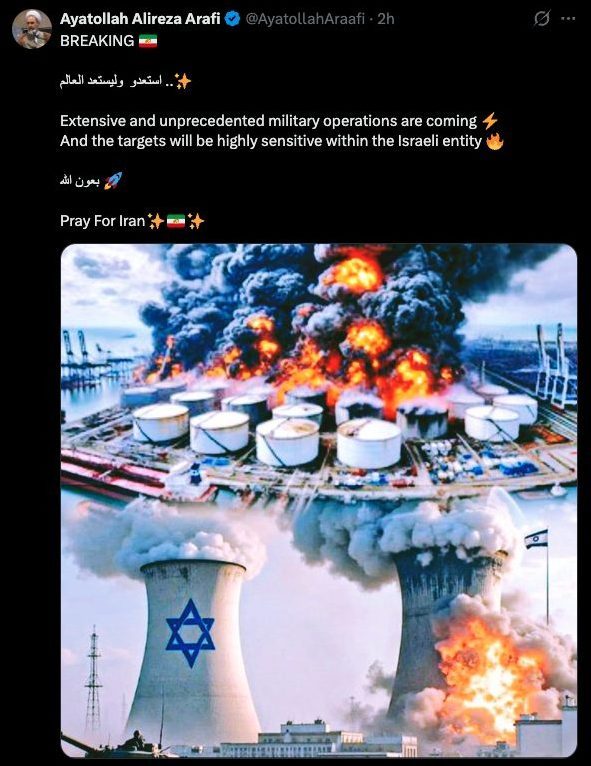

Molte immagini sono state pubblicate da account anonimi o fake sui social. Dopo la morte della Guida Suprema iraniana, Ali Khamenei, le sue funzioni sono passate a un consiglio temporaneo di tre membri: il presidente Massoud Pezeshkian, il capo della magistratura Gholamhossein Mohseni Ejei e il religioso conservatore Ayatollah Alireza Arafi.

Poche ore dopo l’annuncio, su X sono comparsi due account a nome di Arafi. Entrambi creati lo stesso giorno della nomina. Da allora pubblicano contenuti in serie. Materiale non verificato. Immagini false. Contenuti generati con l’IA. Uno dei profili ha persino la spunta blu. Un tempo indicava account istituzionali o figure pubbliche verificate. Oggi è un servizio a pagamento. Non una prova di autenticità. Al momento, non risulta che Arafi abbia un account ufficiale su X.

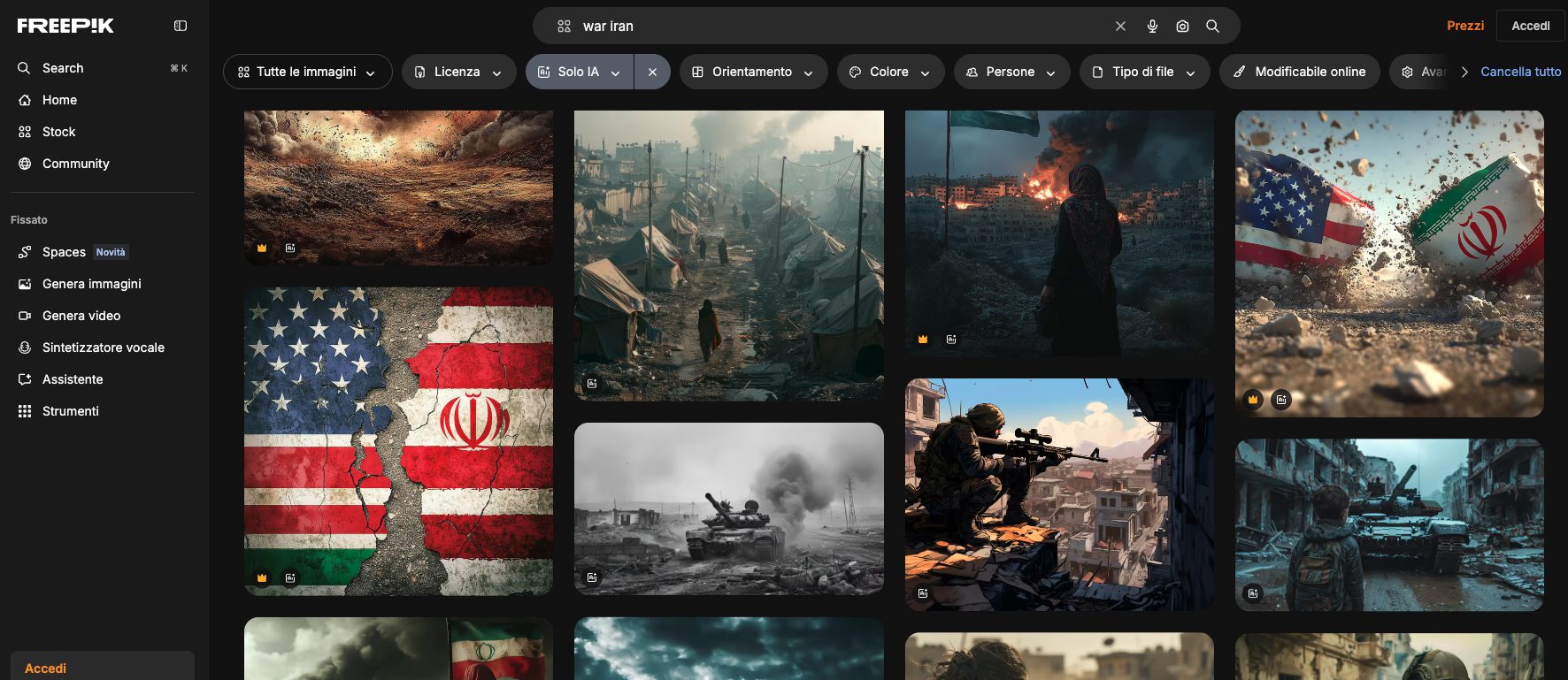

Abbiamo trovato anche decine di contenuti IA sui fornitori di immagini come Freepik e Adobe. Pagine e pagine di bombardamenti e scontri in Iran generate con l’intelligenza artificiale. Ogni immagine è contraddistinta da una didascalia “Generata con IA". Eppure le stesse foto sono rimbalzate su blog, siti, chat, senza nessuna etichetta. Scambiate per immagini reali.

L'era della disinformazione preventiva

Stiamo assistendo a una nuova frontiera del reale sintetico, le immagini create dall'intelligenza artificiale danno forma a una disinformazione preventiva, che racconta eventi mai accaduti generando prove false ma credibili. Negli ultimi mesi abbiamo assistito a un’epidemia di contenuti IA, che hanno reso sempre più difficile riconoscere le immagini false da quelle vere. I nuovi modelli infatti sono performanti e in alcuni casi a occhio nudo, anche per chi è allenato, è difficile distinguerle.

In un contesto di guerra, dove la verifica è già complicata per la rapidità degli eventi e per la scarsità di fonti indipendenti sul capo, la diffusione di materiale generato con l’IA amplifica la disinformazione. Sono immagini che confondono, possono sminuire o amplificare, creare attacchi che non sono mai esistiti o allerte ingiustificate. Non solo, queste immagini possono anche essere strumentalizzate, per manipolare e influenzare l’opinione pubblica. Infine vanno a minare la fiducia nelle immagini autentiche, perché quando tutto può essere falso, anche il vero comincia a sembrare sospetto.