I bombardamenti in Iran sono “più veloci del pensiero” con le armi guidate dall’intelligenza artificiale

Gaza era stato un banco di prova per le armi autonome. Droni, sistemi di sorveglianza intelligente e strumenti di targeting. Ora, con gli attacchi all'Iran stiamo entrando ufficialmente in una nuova fase della guerra moderna. Tradizionalmente, la cosiddetta kill chain – ovvero l’intero processo che va dall’identificazione di un obiettivo fino all’approvazione legale ed esecuzione dell’attacco – richiede tempo, analisi umane e verifiche. Ma i nuovi sistemi basati su IA sono in grado di elaborare quantità immense di dati in tempo reale, riducendo drasticamente i tempi decisionali.

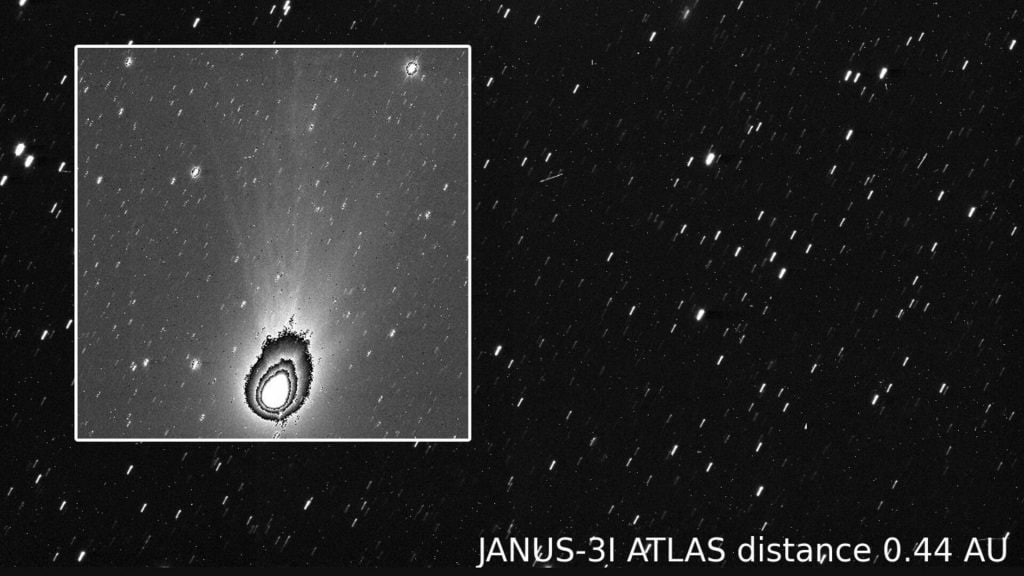

Nei recenti attacchi congiunti statunitensi e israeliani sul suolo iraniano è evidente l’impiego di tecnologie IA. In meno di 48 ore, oltre 6.000 militari statunitensi e circa 2.000 israeliani sono stati coinvolti nelle missioni, con centinaia di bombardamenti e strike contro obiettivi strategici missilistici, nucleari e di comando. Secondo reportage internazionali, nei primi giorni della campagna sono stati lanciati oltre mille attacchi aerei e missilistici, con un uso intensivo di droni, aerei stealth e sistemi avanzati di riconoscimento dei bersagli.

"La macchina dell‘intelligenza artificiale fornisce raccomandazioni su cosa colpire, il che, per certi versi, è molto più rapido della velocità del pensiero", ha spiegato al Guardian Craig Jones, docente di geografia politica all'Università di Newcastle ed esperto di kill chain. Secondo Jones l’eccessiva dipendenza dall’IA può creare un “alleggerimento cognitivo”. In altre parole, chi è chiamato a prendere decisioni su un attacco potrebbe sentirsi emotivamente e moralmente distante dalle sue conseguenze, poiché l’analisi e la valutazione preliminare sono già state elaborate dalla macchina. Non solo, la compressione dei tempi decisionali potrebbe portare all’estromissione progressiva di esperti umani dal cuore delle decisioni belliche, trasformando l’analisi e la selezione dei bersagli in un processo quasi automatizzato.

IA come supporto decisionale nelle operazioni militari: il ruolo di Claude e Palantir

Al centro di molte analisi è il ruolo di Claude, il modello di IA sviluppato dall’azienda statunitense Anthropic. Secondo fonti giornalistiche e agenzie internazionali, questo sistema è stato impiegato dal Comando Centrale degli Stati Uniti (CENTCOM) per supportare fasi cruciali nella pianificazione delle operazioni, integrandosi con piattaforme di analisi dati fornite dalla società Palantir Technologies.

Queste tecnologie utilizzano algoritmi di apprendimento automatico per processare grandi moli di dati: immagini satellitari, intercettazioni telefoniche, informazioni raccolte da droni e intelligence umana. In pratica, l’IA può analizzare, classificare e dare priorità ai potenziali obiettivi, suggerire tipi di armamenti da impiegare e persino valutare gli aspetti legali di un attacco. Secondo alcune ricostruzioni, Claude era già stato utilizzato in Venezuela nel gennaio 2026 per la cattura di Nicolás Maduro.

Dibattito etico e contrasti con il governo USA

Il ruolo dell’IA in ambito militare ha innescato forti tensioni tra Anthropic e il governo degli Stati Uniti. L'azienda infatti si è rifiutata di fornire i suoi modelli al Pentagono. "In un ristretto numero di casi riteniamo che l'IA possa minare, anziché difendere, i valori democratici. Alcuni utilizzi sono semplicemente al di fuori di ciò che la tecnologia odierna può fare in modo sicuro e affidabile”, ha scritto Dario Amodei, fondatore della start up, in un comunicato ufficiale. Dubbi più che fondati, visto che si parla soprattutto di sorveglianza interna di massa e di armi completamente autonome.

La punizione di Trump non si è fatta attendere. Ha ha annunciato che Washington non ha più bisogno dei prodotti dell'azienda e che "non intende più fare affare con essa. Nonostante ciò, Claude è rimasto integrato nei sistemi militari, l'eliminazione dei modelli è prevista nei prossimi mesi.

Parallelamente, altre società come OpenAI hanno rapidamente siglato contratti con il Dipartimento della Difesa per fornire i propri modelli di IA a uso militare, dando il via a una corsa tra le grandi aziende tecnologiche per imporsi in questo settore strategico.

Un futuro incerto per la guerra automatizzata

I sistemi IA applicati alle guerra sollevano questioni etiche, giuridiche e strategiche. L'automazione può erodere la supervisione umana sulle scelte chiave di guerra, creando rischi di escalation incontrollata.

Fino a poco tempo fa sembrava che ci fosse un‘intesa internazionale sui rischi legati alle armi autonome. A febbraio 2020 il United States Department of Defense aveva pubblicato i principi ufficiali per l’uso dell’intelligenza artificiale all’interno dell’intera struttura militare. L’IA, secondo il documento, avrebbe dovuto essere responsabile, equa, tracciabile, affidabile e governabile – cinque criteri pensati per garantire supervisione umana, trasparenza nei processi decisionali.

Sulla stessa linea si è mossa nel 2021 la NATO, che ha adottato principi analoghi per l’impiego dell’IA in ambito difensivo, sottolineando la necessità di mantenere il controllo umano sulle decisioni critiche. Nel 2022 anche il Government of the United Kingdom ha formalizzato un quadro etico per l’uso militare dell’intelligenza artificiale, ribadendo l’importanza della responsabilità legale e della supervisione operativa. Oggi queste promesse sono state tradite.