Anthropic cerca esperti di armi chimiche su LinkedIn: manca un tassello nell’intelligenza artificiale

Dopo il braccio di ferro con la Casa Bianca, Anthropic sta vivendo un significativo rafforzamento della propria reputazione. La decisione dell'azienda di Dario Amodei di rinunciare agli accordi con il Pentagono pur di non consentire al proprio modello di intelligenza artificiale di essere impiegato nella sorveglianza di massa e nello sviluppo di armi completamente autonome ha contribuito a consolidarne l'immagine di organizzazione etica. Una percezione che ha spinto molti utenti ad abbandonare ChatGPT per spostarsi su Claude, il chatbot sviluppato proprio dalla società.

Anthropic non è però né una onlus né un'associazione di beneficenza. I suoi modelli di IA continuano a essere pienamente integrati nelle strategie statunitensi, tanto da giocare un ruolo di primo piano anche nelle operazioni di queste settimane sul fronte iraniano. La linea tracciata da Amodei non è infatti un rifiuto integrale all'impiego bellico dell'IA, ma mira a distinguere tra applicazioni di supporto e lo sviluppo diretto di sistemi offensivi autonomi. Per questo quando alcuni utenti sui social si sono accorti di un particolare annuncio su LinkedIn sono subito ripartite voci e dubbi sul ruolo dell'azienda nell'ormai imprevedibile macchina bellica americana.

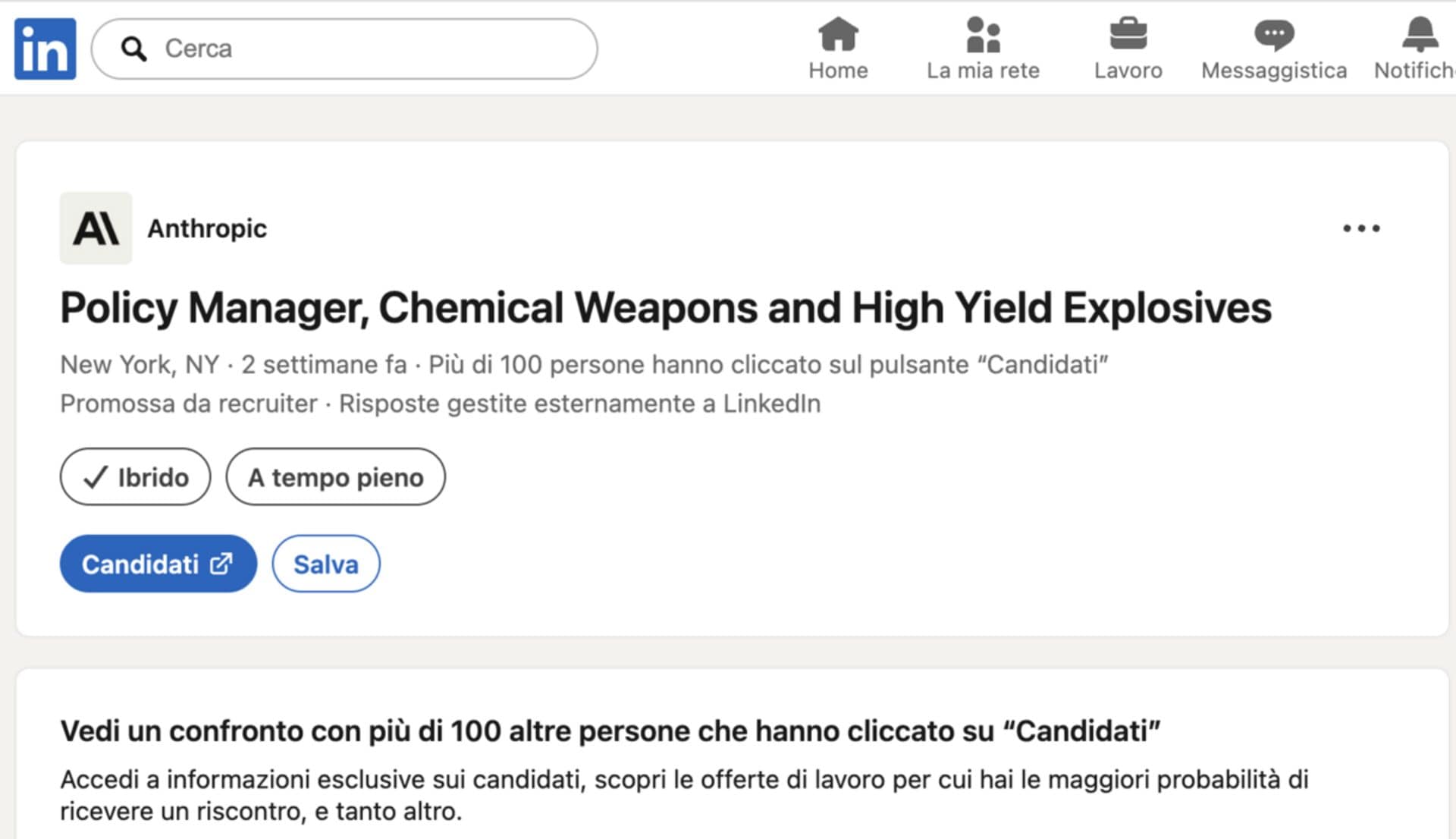

Negli scorsi giorni Anthropic ha aperto una posizione per un "Policy Manager, Chemical Weapons and High Yield Explosives". Una descrizione che, isolata dal contesto, ha alimentato interpretazioni allarmistiche: perché un'azienda di intelligenza artificiale dovrebbe cercare un esperto di armi chimiche ed esplosivi? La risposta, leggendo nel dettaglio l'offerta, è però l'opposta a quanto suggerito dalle letture più complottiste.

Perché Anthropic cerca un esperto di armi chimiche

Come si può leggere nella stessa descrizione della posizione lavorativa, l'obiettivo dell'offerta di lavoro non è infatti reclutare uno scienziato malvagio per sviluppare armi letali, ma anzi prevenire la possibilità che i modelli di IA possano essere utilizzati per farlo. Il ruolo prevede la progettazione di sistemi di valutazione e controllo per impedire che l'IA fornisca informazioni sensibili su sintesi chimiche, esplosivi o dispositivi radiologici.

In altre parole, Anthropic teme che i propri strumenti possano essere sfruttati per scopi illeciti e vuole rafforzare le barriere di sicurezza. Secondo l'annuncio, il candidato ideale deve avere almeno cinque anni di esperienza nella difesa contro armi chimiche o esplosivi e competenze specifiche anche sui cosiddetti "dispositivi di dispersione radiologica", le bombe sporche. Tra le responsabilità figurano lo sviluppo di modelli di minaccia, l'analisi delle richieste sospette e la creazione di "guardrail" per impedire risposte pericolose. L'azienda parla esplicitamente di "prevenzione di utilizzi catastrofici" e di un lavoro al servizio di "sistemi di IA sicuri e vantaggiosi per la società".

Un'esigenza condivisa nel settore

Quello di Anthropic non è affatto un caso isolato. Anche OpenAI ha recentemente pubblicato annunci per rafforzare il proprio team di sicurezza con esperti incaricati di monitorare i "rischi catastrofici" legati ai modelli più avanzati. Per funzionare in modo affidabile l'intelligenza artificiale deve infatti essere addestrata non solo a rispondere, ma anche a non farlo quando necessario. Più i modelli diventano potenti e informati, più cresce il rischio che possano fornire indicazioni pericolose. Da qui la necessità di integrare competenze altamente specialistiche, anche in ambiti sensibili come quello militare.